AIで点数は上がる。でも「自分の力」は伸びている? ── メタ認知の罠

AIで点数は上がる。でも「自分の力」は伸びている? ── メタ認知の罠

ChatGPTで宿題が片付いた。模試の点数も上がった。でも、本当に「自分の力」が伸びているのか。最新研究が見せる、AI時代の落とし穴を一緒に確認しよう。

🚨 こんな経験はないだろうか

・AIに小論文を直してもらったら、自分でも書けそうな気がしてきた

・AIで解いた数学の問題、提出後に同じ問題を出されたら解けなかった

・「AIを使いこなしている」と感じているけど、何も覚えていない

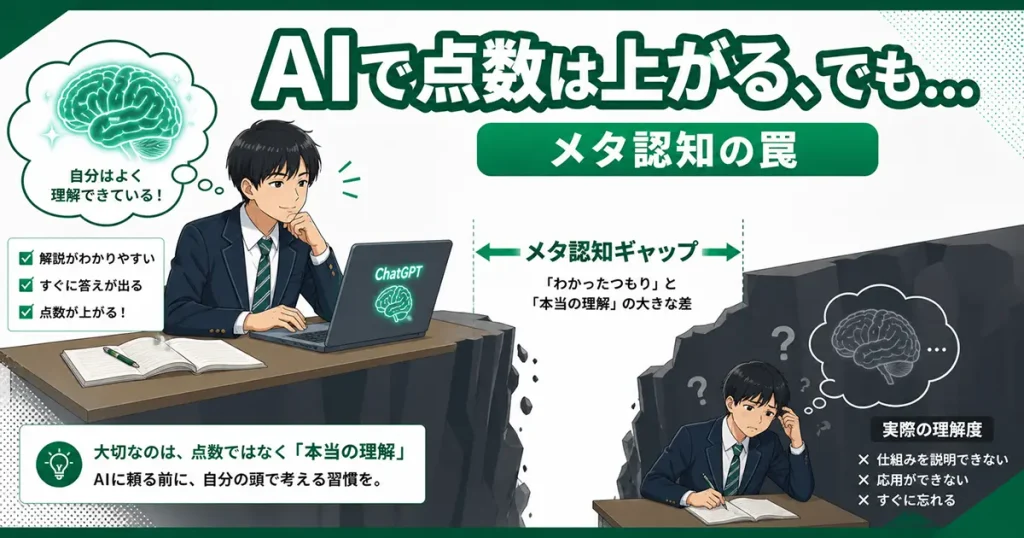

これらはすべて、ある共通の現象につながっている。それが 「メタ認知のズレ」 だ。

「成績は上がる、でも本人は気づかない」研究結果

2026年2月、専門誌『Computers in Human Behavior』に衝撃的な研究が掲載された。タイトルは 「AI makes you smarter but none the wiser(AIはあなたを賢くするが、賢明にはしない)」。アアルト大学(フィンランド)を中心とした国際研究チームが、約700人を対象に行った2つの大規模実験の結果である。

実験では、参加者にアメリカのロースクール入学試験(LSAT)レベルの論理推論問題を解かせた。半分はAIを使い、半分は使わない。各問題のあと「自分はどれくらいできたと思うか」を自己評価させ、正確に評価できれば追加報酬を払う、というルールだった。

AI使用グループの実際のスコア向上

+3点

AI使用グループの「自己評価の上振れ」

+4点

つまり、AIを使った人は 確かに3点ぶん成績が上がった。しかし同時に、自分の実力を 4点ぶん過大評価していた。実力の伸び以上に「自分はできる」と思い込んでしまうのである。

さらに興味深いのが、「AIに詳しい人ほど、自分の出来を正確に見積もりにくい傾向が見られた」 という結果だ。「自分はAIを使いこなしている」と感じている人ほど、自分の本当の理解度を実態より高めに評価しがちだったのである。

「現在のAIツールはメタ認知を育てない。私たちは自分の間違いから学べていない」

— Daniela Fernandes博士(アアルト大学), 研究チーム代表コメントより

そもそも「メタ認知」とは何か

メタ認知とは、ひとことで言えば 「自分の思考を、もう一人の自分が見つめる力」 のことだ。

たとえば模試を受けて、「この大問は7割は取れたな」「この英文、文法は分かるけど語彙が弱い」と感じる、あの感覚である。「自分が何を知っていて、何を知らないか」を正確に把握する能力。これが、勉強・受験・将来の仕事のすべてで決定的に重要になる。

なぜ重要か。シンプルだ。苦手が分からなければ、対策のしようがないからだ。

💡 メタ認知が強い人 vs 弱い人

・強い人:「自分は確率が苦手」と分かっている → 集中的に対策できる

・弱い人:「全部できているつもり」 → 試験本番で初めて穴に気づく

AIは「点数」は上げてくれるが、この 「自分の穴を見つける力」を育ててくれないのが問題なのだ。

MIT研究:ChatGPT使用時、脳の接続性が大きく低下

もう一つ押さえておきたい研究がある。2025年6月、マサチューセッツ工科大学(MIT)メディアラボがプレプリント論文「Your Brain on ChatGPT」を公開した。

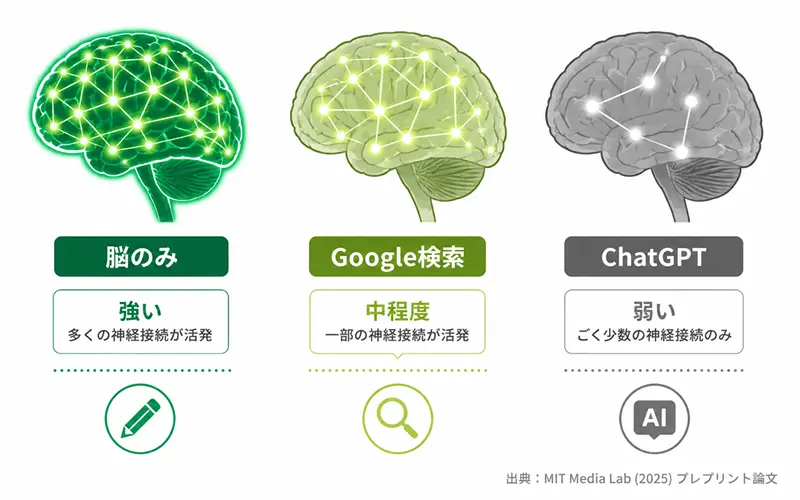

54人の被験者を3グループに分け、SAT形式のエッセイ課題に取り組んでもらった。グループは ①ChatGPT使用、②Google検索使用、③何も使わない(脳のみ) の3条件。執筆中、参加者の脳波(EEG)を測定した。

| グループ | 脳の神経接続性 | 記憶の定着 | 所有感(自分が書いた感) |

|---|---|---|---|

| 脳のみ | 最も強く広範 | 引用を再現できる | 強い |

| Google検索 | 中程度 | ある程度再現可 | 中間 |

| ChatGPT | 最も弱い | 正確な引用が困難 | 弱い |

論文(プレプリント)の要旨によれば、ChatGPT利用グループでは脳の神経接続性が3グループの中で最も弱く、エッセイへの所有感(自分が書いた感)も最も低かったという。LLMユーザーは自分が書いたばかりの文章を正確に引用するのにも苦労していた、と研究者らは報告している。

📌 「55%低下」という数値について: 一部の二次報道では「脳活動が55%低下」という具体的な数値が引用されているが、論文の公開要旨にはこの数値の明示はなく、本記事では 「傾向として弱まる」 という方向性で理解しておきたい。一次情報を確認しながら読むことが、AIリテラシーそのものでもある。

研究者のNataliya Kosmyna氏らは、こうしたLLM利用が長期的にもたらしうるコストを 「認知的負債(Cognitive Debt)」 と呼んでいる。これは正式な学術用語というより 説明のための比喩 であり、「AIに思考を肩代わりさせるたびに、本来鍛えられるはずだった脳の働きが借金のように積み上がっていく」という研究者のメッセージを表したものだ。

⚠️ 注意: MITの研究は査読前のプレプリント論文で、被験者数も54人と多くない。「AIで脳が壊れる」と単純化するのは誤りである。ただし、Fernandes(2026)のメタ認知研究と合わせて読むと、「AI使用がメタ認知や記憶定着に影響を与えうる」という方向性は複数の研究で一致しつつある、と言える。

なぜ気づきにくいのか ── ダニング・クルーガー効果との関係

「分からない人ほど、自分は分かっていると思い込む」

これを ダニング・クルーガー効果 と呼ぶ。心理学では古くから知られた現象だ。

面白いのは、Fernandes(2026)の研究で 「AIを使うと、本来あった『できる人とできない人の自己評価の差』が見えにくくなる」 という結果が出たことである。一見「いいこと」に聞こえる。しかし内容をよく読むと、こういうことだ ──

本来できない人も、できる人も、全員が同じくらい「自分を過大評価する」ようになった。

つまり、AIによって「上下の差」が見えにくくなる代わりに、全員がそろって自信過剰になった。これは、自分の弱点に気づける人がいなくなったということでもある。受験や進路選択のように 「自分の現在地を正確に知る」ことが死活的に重要な場面では、致命的な落とし穴になりうる。

高校生にとって、何が問題になるのか

① 模試・定期テストの判定が信用できなくなる

「いつもAIに聞きながら勉強していた範囲」と「自力で取り組んだ範囲」を比べたとき、本番で差が出るのは前者の可能性が高い。脳の処理経路が違うからだ。普段AI込みで「分かったつもり」になっていた箇所は、試験本番のような AIなしの環境で再現できない。

② 志望理由書・小論文で「自分の言葉」が出ない

総合型選抜・学校推薦型選抜・AO入試の面接で、提出書類について深く質問されたとき。AIで書いた志望理由書だと、自分でも書いた中身が曖昧になっている、という事故が起きうる。MITの研究で 「ChatGPT使用者は書いた直後でも内容を正確に再現できない傾向」 が示されたとおりだ。

③ 「学習したつもり」のまま受験本番を迎える

これが最も怖い。Fernandes(2026)の言葉を借りれば、「成績は3点伸びるが、自己評価は4点伸びる」。実力の伸び以上に「できる気」になる。受験までの1年で、この差は埋めようのない開きになる。

🎯 ここが本質

AIは「敵」ではない。問題なのは 「使い方」 だ。

AIに丸投げすると、成果物の質は上がるのに、自分の能力と自分の能力に対する正確な認識の両方が育たない。これは「使うのをやめろ」ではなく、「メタ認知が育つ使い方に変えろ」という話である。

メタ認知を守るAIの使い方 ── 5つのステップ

研究者らが提案している方向性と、教育現場での実践例を組み合わせた、高校生向けの実践ガイドを紹介する。

「答えを聞く」前に「自分の答え」を書く

数学の問題でも、英作文でも、まず 5分でいいから自力で考える。途中まででいい。答えではなく 「自分はここで詰まった」という地点をメモしてからAIに聞く。これだけでメタ認知の働きが残る。

AIの答えを「説明し直す」

AIが出した答えを、AIなしで 誰かに説明できる形に書き直す。Fernandes博士は研究の結論で「AIは利用者に推論を説明させるべきだ」と提言している。説明できないなら、それは「分かったつもり」のサインだ。

AIの答えに「ツッコミを入れる」

AIは堂々とウソをつく(ハルシネーション)。「その根拠は?」「他の考え方は?」「反対意見は?」と聞き返す。これが批判的思考のトレーニングになる。AIを「先生」ではなく「議論相手」として扱う。

AIなしで再現できるかチェック

AIで解いた問題と似た問題を、翌日 AIなしで解き直す。再現できなければ、それは身についていない。「AI込みでできる」は実力ではない、と認める勇気が要る。

「AIを使った時間」と「使わなかった時間」を分ける

1日の勉強時間のうち、AIを使わない時間を必ず確保する。深く考える力を保つためには、自力で考える時間が必要だとMIT研究は示唆している。手書きノートで考えをまとめる、ペンを置いて頭の中だけで論を組み立てる ── そんな時間を残しておく。

※目安:AIを使う時間は全体の3〜5割以内に抑えるとバランスが取りやすい。

文部科学省も注意を呼びかけている

2024年12月、文部科学省は 「初等中等教育段階における生成AIの利活用に関するガイドライン Ver.2.0」 を公表した。生成AIの活用を全面的に認める一方で、「直接的な解答を提示するツールへの過度な依存や認知的努力の代替により学習の深化を損なうリスク」を明記している。

OECD(経済協力開発機構)も2026年の報告書「Digital Education Outlook 2026」で、生成AIへの過度な依存は 学習成果や認知への影響 という観点で慎重な検討が必要だ、という方向性を示している。世界中の研究機関や教育機関が同じ方向の問題意識を持ちはじめている、と言える。

AIネイティブ世代が最も気をつけるべきこと

今の高校生は、初めから生成AIが存在する世界で勉強している、いわば 「AIネイティブ世代」だ。これは大きな強みでもある。AIを使いこなせること自体は、これからの時代で必須スキルになる。

ただし、Fernandes(2026)が示したように 「AIに詳しい人ほど、自分の出来を正確に見積もりにくい傾向」があるのだとすれば、AIネイティブ世代こそが最もこの罠に落ちやすいとも言える。「使える」と「賢い」は別物なのだ。

🌱 結局、何を意識すればいいか

受験勉強でも、課題でも、調べ物でも、こう自問する習慣をつけよう。

「AIなしの自分は、これをどこまで分かっているのか?」

この一言が、AI時代に 「自分の頭」を守る最も大切な視点 になる。

📌 この記事のポイント

・最新研究(Fernandes 2026)で、AIで成績は3点上がるが、自己評価は4点上振れると判明

・MIT研究では、ChatGPT使用時に 3グループの中で最も脳の神経接続性が弱い傾向、書いた内容を直後に正確に再現できない傾向が観測

・「AIに詳しい人ほど自分の出来を正確に見積もりにくい」傾向 ── AIネイティブ世代こそ要注意

・対策は「AIを使うな」ではなく 「メタ認知が育つ使い方に変える」

・自力で考える時間→AIに聞く→自分で説明し直す、のサイクルを意識する