【中学生向け】その画像、本物?AI画像・偽動画(ディープフェイク)の見分け方

その画像、本物?AI画像・偽動画(ディープフェイク)の見分け方

SNSで見かける衝撃的な写真や動画、じつはAIが作った「ニセモノ」かもしれません。だまされないための見分け方を身につけましょう。

AIが作る「ニセモノ」が当たり前の時代に

最近のAI(人工知能)は、本物そっくりの画像や動画をかんたんに作れるようになりました。実在しない人の顔写真、起きていない災害の映像、有名人が言っていないことを話す動画——こうしたAIが作り出したニセモノのコンテンツは「ディープフェイク」と呼ばれ、世界中で問題になっています。

スマホアプリでもかんたんに作れてしまうため、10代の若者が「おもしろ半分」で作って大きなトラブルになるケースも急増しています。

中高生にも広がるディープフェイク被害

「ディープフェイクなんて自分には関係ない」と思っていませんか?じつは、被害は10代にこそ広がっています。

⚠️ 警察庁の調査結果(2025年1〜9月)

・18歳未満の性的ディープフェイク被害の相談は79件

・被害者の約8割が中高生(小学生の被害もあり)

・加害者の約半数が同じ学校の生徒(同級生や先輩)

・名誉毀損容疑での摘発4件、補導6件

卒業アルバムやSNSに載せた写真がAIで加工され、性的な画像にされてしまう——そんな被害が現実に起きています。「軽い気持ち」で友達の写真を加工しても、犯罪の加害者になることを知っておきましょう。

AI画像の見分け方チェックポイント

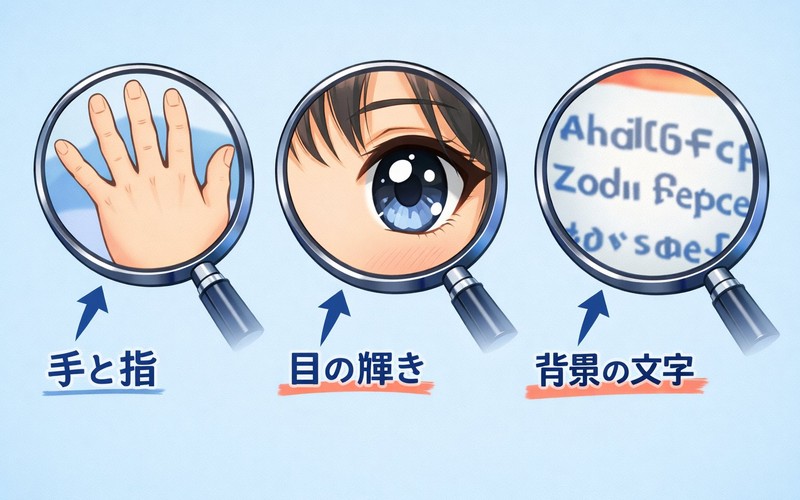

AIが作った画像は年々リアルになっていますが、よく見ると不自然な部分が見つかることがあります。以下のポイントをチェックしてみましょう。

👋 手や指をよく見る

AI画像でもっとも破綻しやすいのが手と指です。指の本数が多かったり少なかったり、関節の曲がり方が不自然だったりします。画像の中に手が写っていたら、まず指の本数と形を確認しましょう。

👁️ 目や瞳に注目する

AI画像の目は、瞳の中の光の反射が左右で異なっていたり、不自然に均一だったりします。「なんとなく目が死んでいる」「表情に違和感がある」と感じたら要注意です。

🔍 背景や細部をチェックする

AI画像の人物にばかり目がいきがちですが、背景にこそヒントがあります。文字がぐにゃぐにゃになっている、建物の形が歪んでいる、左右で辻褄が合わないなどの「おかしなところ」がないか確認しましょう。

🏷️ 透かし(ウォーターマーク)を探す

ChatGPTやGoogleのAIツールで作った画像・動画には、「AIで作りました」という透かし(ウォーターマーク)が入っていることがあります。画像の隅やプロパティ情報を確認してみましょう。YouTubeやTikTokでも、投稿者が「AI生成」のラベルをつけていることがあります。

偽動画(ディープフェイク動画)の見分け方

動画の場合は、静止画とはまた違うチェックポイントがあります。

🎬 動画のチェックポイント

・口の動きと音声がズレていないか:セリフに対して唇の動きが合っているかをよく見ましょう。再生速度を遅くするとわかりやすいです

・まばたきの頻度:まばたきが極端に少ない、または一定のリズムで不自然なパターンになっていませんか

・表情の変化:感情に対して表情が固い、ロボットのようにぎこちない場合はAI生成の可能性があります

・物が突然消える・現れる:背景にある物体が一瞬で消えたり、形が変わったりすることがあります

・旗やロゴなどのデザインが正確か:AIは国旗の星の数やブランドロゴなどの細部を間違えることがあります

だまされないための3つの習慣

AI技術は日々進化しているので、見た目だけで見分けるのはどんどん難しくなっています。だからこそ、「見分ける力」だけでなく「疑う習慣」を身につけることが大切です。

① まず疑う——「これ本当?」と立ち止まる

SNSで衝撃的な画像や動画を見たとき、すぐにリアクションしたり拡散したりせず、「これ、本当かな?」と一度立ち止まりましょう。とくに感情をゆさぶるような内容ほど、フェイクの可能性があります。

② 情報の出どころを確かめる

その画像・動画は誰が・いつ・どこで投稿したものですか?信頼できるニュースサイトが同じ内容を報じているかどうか、別のソースでも確認するクロスチェックの習慣をつけましょう。

③ 拡散する前に考える

もしフェイクだと気づかずに拡散してしまうと、自分も偽情報を広める側になってしまいます。確信が持てない情報は、シェアやリポストをしないようにしましょう。

自分の写真が悪用されないために

ディープフェイクは、あなたの写真が「材料」にされて作られます。自分を守るためにできることも知っておきましょう。

⚡ 自分を守るためにできること

・SNSに顔がはっきり写った写真を安易に公開しない(公開範囲を限定する)

・知らない人からのフォローリクエストをむやみに承認しない

・卒業アルバムや集合写真をネットにアップしない

・友達の写真をAIで加工する行為は絶対にしない(犯罪になります)

もしディープフェイク被害にあったら

自分の画像が勝手にAIで加工された、偽の画像・動画が出回っている——そんなときは、一人で抱え込まずにすぐ行動しましょう。

✅ 被害にあったときの対応

・証拠を保存する:スクリーンショットを撮り、URLを記録する

・信頼できる大人に相談する:保護者、先生、スクールカウンセラーなど

・警察に相談する:最寄りの警察署、または#9110(警察相談専用電話)

・削除を要請する:SNSの通報機能を使って投稿の削除を申請する

・法務局の相談窓口:インターネット上の人権侵害について相談できます

📌 この記事のポイント

・AI画像は手の指・目の輝き・背景の不自然さで見分けられることがある

・偽動画は口と音声のズレ、まばたき、表情の硬さに注目

・「本当?」と疑い、出どころを確認し、安易に拡散しない習慣をつけよう

・自分の顔写真のSNS公開はリスクを理解して慎重に

・友達の画像をAIで加工するのは犯罪——絶対にやらない、やらせない