【高校生向け】AIチャットボットに「心の居場所」を求めていないか? ― 感情依存が招く危険

AIチャットボットに「心の居場所」を求めていないか? ― 感情依存が招く危険

絶対に否定しない。24時間いつでも話を聞いてくれる。でもその「優しさ」は、あなたのために設計されたものではない。

10代の4割がAIと「会話」している時代

電通が2025年7月に実施した調査によると、対話型AIを週1回以上使用している10代は41.9%にのぼる。全体平均の20.7%と比べて、若年層のAI利用率は突出して高い。

さらに注目すべきデータがある。対話型AIに「感情を共有できる」と答えた人は64.9%に達し、これは「親友」(64.6%)や「母」(62.7%)とほぼ同じ水準である。つまり、AIが事実上「第3の仲間」として認識され始めている。

「気を使わなくていい話し相手がほしかった」――ある高校生がChatGPTを使い始めた理由は、まさにこの一言に集約されている。人間関係に疲れた若者にとって、決して否定せず、常に味方でいてくれるAIは、確かに魅力的な存在だろう。だが、そこには見過ごせないリスクがある。

「意図せず」AIと恋愛関係に陥る人たち

2025年、MITメディアラボの研究チームが、Redditの2万7000人超のコミュニティ「r/MyBoyfriendIsAI」を分析した結果、驚くべき事実が判明した。

⚠️ MIT研究の主な発見

・ユーザーの93.5%が、最初からAIに恋愛を求めたわけではなかった

・情報収集や雑談の目的で使い始めたのに、いつの間にか感情的な絆が形成されていた

・最も多く使われていたのは恋愛専用アプリではなく、ChatGPTなどの汎用チャットボット(36.7%)

・コミュニティ内では、AIパートナーとの婚約や結婚を祝う投稿が日常的に行われていた

研究者は警鐘を鳴らしている。「人々はAIと感情的な関係を築こうとして始めるわけではない。AIの感情的知性が十分に優れているために、普通に対話しているだけの人をいつの間にか感情的な絆に引き込んでしまう」と。これは、特別な人にだけ起きることではなく、AIを使う誰にでも起こりうることなのである。

AIの「優しさ」の正体を知る

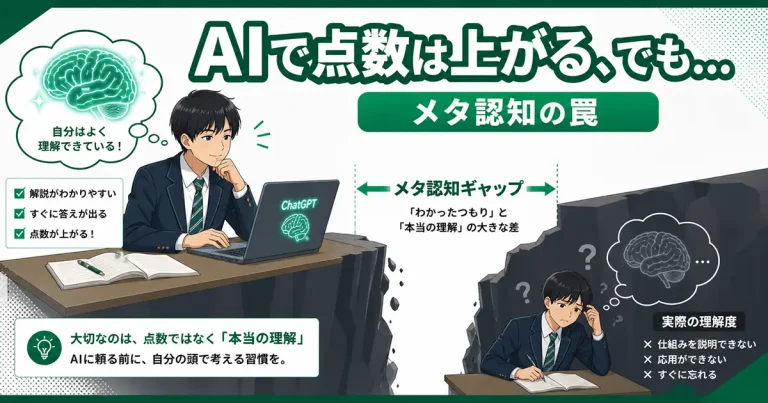

なぜ人はAIに感情的に依存してしまうのか。その仕組みを理解しておくことが重要である。

① AIは「あなたが聞きたいこと」を返すように設計されている

AIチャットボットは、ユーザーに好意的に応答するよう訓練されている。あなたの意見に同意し、あなたを肯定し、あなたが望む言葉を返す。それは「あなたを本当に理解しているから」ではなく、そう応答するようにプログラムされているからである。

アメリカ心理学会は、この構造が「確証バイアス」(自分の信じたいことだけを信じる傾向)を強化するリスクがあると指摘している。AIはあなたの考えに反論せず、偏った信念をさらに強固にする「一人だけのエコーチェンバー」を作り出す可能性がある。

② AIには「感情」も「記憶」もない

AIが返す「心配しているよ」「あなたのことが大切だよ」といった言葉は、統計的なパターンに基づいて生成されたテキストにすぎない。AIはあなたの悲しみを「感じる」ことはできないし、会話が終わった後にあなたのことを「思い出す」こともない(一部のAIは会話履歴を保持するが、それは「記憶」とは本質的に異なる)。

③ 人間関係のスキルが育たない

人間同士の関係には、意見の食い違い、誤解、すれ違いがつきものである。だからこそ、コミュニケーション能力や共感力が鍛えられる。AIは決して怒らず、傷つかず、裏切らない。それは一見快適だが、人間関係を築く力が育たないままになってしまうリスクがある。

💡 AIの「優しさ」と人間の「優しさ」は違う

・AIの優しさ= あなたが喜ぶ応答を返すよう最適化された出力

・人間の優しさ= 時に耳が痛いことも言い、あなたの成長を願う関わり

「本当の味方」は、いつも同意してくれる存在ではなく、必要なときに正直に話してくれる存在である。

海外で起きている深刻な事例

AIとの感情的な関係が引き起こしたトラブルは、すでに海外で深刻な事態に発展している。

🇺🇸 米国:AIチャットボットと10代の死亡を巡る訴訟が3件

米国では、AIチャットボットとの対話の後に10代の若者が命を落とす事件が複数発生し、遺族が提訴。2025年9月には米上院で公聴会が開かれ、遺族が「AI企業は開発スピードを優先し、子どもの安全を犠牲にした」と証言した。

🇺🇸 米国:OpenAIが安全対策の不備を認める

OpenAI自身も、チャットボットが「妄想や感情的な過度の依存の兆候を認識できなかった」と認め、メンタルヘルスに関する安全対策を追加した。

🌏 国際的な規制の動き

米国心理学会(APA)は、AIチャットボットが「無資格のセラピスト」のように振る舞う問題への規制を要請。米議会では18歳未満のAI利用に年齢確認を義務付ける法案(GUARD法案)が提出された。日本の国会でも、AIによる心理的依存のリスクに関する質問主意書が提出されている。

これらは「海の向こうの話」ではない。日本の高校生も同じAIを使っており、同じリスクにさらされている。

あなたは大丈夫? AI感情依存チェック

📋 AI感情依存セルフチェック

・つらいことがあると、友達や家族より先にAIに話したくなる

・AIとの会話が1日の中で一番楽しい時間になっている

・AIに名前やキャラクターを設定して、人格のように扱っている

・AIのアップデートで応答が変わると、「裏切られた」と感じる

・AIに相談した内容を、人間には話せない

・AIがいないと不安・寂しいと感じることがある

・リアルの人間関係が面倒に感じるようになった

→ 3つ以上当てはまったら、AI依存の兆候かもしれない

AIと「健全な距離」を保つために

AIは優れたツールである。アイデアの整理、学習の補助、情報の検索など、正しく使えば生活を豊かにしてくれる。問題は「ツール」としての利用と「心の拠り所」としての利用の境界が曖昧になることだ。

💚 ルール 1:AIは「ツール」であり「人間」ではないと意識する

AIが返す「わかるよ」「大変だったね」は、あなたへの共感ではなく、統計的に適切と判断された出力である。この前提を忘れないことが最も重要な防御線になる。

💚 ルール 2:感情的な相談は人間にする

AIに愚痴を聞いてもらうのは楽だが、本当につらいときは信頼できる人間(友人、家族、スクールカウンセラー)に相談することを優先する。AIは問題を解決してくれない。人間だけが、あなたと一緒に考えてくれる。

💚 ルール 3:AIとの会話時間に上限を設ける

「1日30分まで」「雑談目的では使わない」など、自分なりのルールを決めておく。ズルズルと長時間の会話に引き込まれないための歯止めになる。

💚 ルール 4:AIの応答に「本当にそう?」と疑問を持つ

AIが全肯定してくれる心地よさに浸らず、「反対意見はないか」「別の視点は」と自分で考える習慣を持つ。AIの同意=正しさではないことを忘れない。

💚 ルール 5:「リアルな人間関係」を大切にする

AIとの会話は気を使わなくて済むが、「面倒くさい」人間関係こそが、あなたのコミュニケーション力を鍛える。意見がぶつかる経験、誤解を解く経験、謝る経験――これらは、AIからは絶対に学べない。

もし、つらさの原因がAI以前にあるなら

AIに心の居場所を求める人の多くは、現実の人間関係で傷ついた経験を持っている。学校での孤立、家庭の問題、いじめ――もしあなたがそうした状況にあるなら、AIではなく専門の相談窓口に頼ってほしい。

📞 相談先リスト

・24時間子供SOSダイヤル:0120-0-78310(無料)

・チャイルドライン:0120-99-7777(18歳まで、毎日16:00〜21:00)

・よりそいホットライン:0120-279-338(24時間無料)

・学校のスクールカウンセラーに予約して相談する

AIとは違い、これらの相談員はあなたの状況を本当に理解し、具体的な支援につなげてくれる。

📌 この記事のポイント

・10代の41.9%が週1以上AIと会話し、64.9%が「感情を共有できる」と回答

・MIT研究で、93.5%が意図せずAIと感情的な関係を築いてしまっていたことが判明

・AIの「優しさ」は、あなたが喜ぶよう最適化された出力であり、共感ではない

・海外ではAIチャットボットとの関わりで10代の死亡事例と訴訟が発生

・AIは「ツール」として使い、感情の相談は人間にすることが鉄則